Basis-Absicherung im Heimnetz

Das eigene Heimnetzwerk zu verwalten, ist heute weit mehr als nur ein technisches Hobby. Wer eigene Web-Dienste hostet oder seine IT-Infrastruktur selbst aufbaut, gewinnt vor allem eines: Transparenz und Datenhoheit. Indem wir uns von proprietären Cloud-Diensten und externen Plattformen lösen, reduzieren wir Abhängigkeiten und behalten die volle Kontrolle über unsere digitalen Spuren.

Doch mit der Freiheit kommt die Verantwortung. Auch private Infrastrukturen benötigen eine angemessene Absicherung. Die gute Nachricht: Wir müssen das Rad nicht neu erfinden. Die bewährten Empfehlungen des BSI (Bundesamt für Sicherheit in der Informationstechnik) aus dem IT-Grundschutz bieten eine ideale Blaupause für das private Netz. Während die Schutzziele den strategischen Rahmen bilden, ist die technische Umsetzung ein dynamischer Prozess: Sie passt sich dem Wissensstand und den Anforderungen der eigenen Infrastruktur an, nutzt aber die Bausteine des IT-Grundschutzes als verlässliches Fundament.

| Schutzziel | Schutzmaßnahme | Technik |

|---|---|---|

| 🔐 Vertraulichkeit | 🧱 Isolation | 🔒 WireGuard |

| 🧩 Integrität | 🚦 Filterung | 🛡️ Fail2Ban |

| ♻️ Verfügbarkeit | 📈 Monitoring | 📊 Prometheus |

Der Schutzbedarf einer privat betriebenen Infrastruktur kann in allen drei Schutzzielen als normal eingestuft werden. Rechtliche, finanzielle und personelle Auswirkungen von Sicherheitsvorfällen sollten begrenzt sein. Entsprechend ist die Basis-Absicherung aus dem IT-Grundschutz und darin empfohlene technische Maßnahmen für die Schutzmaßnahmen mehr als ausreichend. Dieser werden in den folgenden drei Abschnitten näher erläutert.

Vertraulichkeit durch Isolation mit WireGuard

Vertraulichkeit bedeutet im Kern, dass nur berechtigte Personen oder Systeme Zugriff auf Daten und Funktionen haben. In meinem Heimnetz setze ich das durch eine strikte Trennung um: Öffentlich erreichbare Dienste werden klar von internen Systemen isoliert. Anstatt das gesamte Netzwerk zu öffnen, werden nur gezielt definierte Anwendungen nach außen exponiert. Sensible Bereiche wie Management-Oberflächen, interne APIs oder Wartungszugänge bleiben im Verborgenen. Der Zugriff auf diesen geschützten Bereich erfolgt exklusiv über ein privates Netzwerk, in meinem Fall mit dem VPN WireGuard. Nur Clients mit hinterlegten Schlüsseln können eine Verbindung aufbauen, wobei das VPN gleichzeitig die Verschlüsselung, Authentifizierung und Autorisierung übernimmt.

Innerhalb dieses privaten Netzes verlasse ich mich nicht auf ein „flaches“ Vertrauensmodell, bei dem jeder mit jedem reden darf. Stattdessen sorgt eine segmentierte Architektur mit restriktiven Firewall-Regeln für Ordnung: Systeme kommunizieren nicht beliebig, sondern ausschließlich über explizit definierte Pfade. Diese Kombination aus sicherem Außen-Zugang per VPN und interner Isolation schafft eine kontrollierte Struktur, die unbefugte Zugriffe effektiv unterbindet und die Hoheit über die eigenen Daten sicherstellt.

Integrität durch Filterung mit Fail2Ban

Integrität bedeutet im Kern, dass Systeme und Daten in einem korrekten, unverfälschten Zustand bleiben. Als zentrale Schutzmaßnahme setze ich hierfür Fail2Ban ein – ein regelbasiertes Intrusion-Prevention-System, das Server-Logs in Echtzeit analysiert. Das Tool fungiert als digitaler Türsteher: Es identifiziert auffällige Zugriffsmuster und sperrt die verursachenden IP-Adressen temporär auf Firewall-Ebene. Die Bewertung erfolgt dabei anhand definierter Filter, die auf Basis von HTTP-Statuscodes oder ungewöhnlichen Zugriffshäufigkeiten entscheiden, ob ein Client blockiert wird.

Bestimmte HTTP-Statuscodes dienen mir dabei als technische Indikatoren, um fehlgeschlagene oder abgewehrte Einbruchsversuche automatisiert zu interpretieren. Während erfolgreiche Anfragen oft unauffällig bleiben, signalisieren gehäufte Fehlermeldungen (wie etwa 404-Suchen nach Admin-Backends oder 403-Zugriffsverweigerungen) eine bösartige Interaktion zwischen Client und Server. Da erfolgreiche Antworten allein keinen unmittelbaren Hinweis auf einen Angriff liefern, ergänze ich diese reaktive Sperrung durch ein kontinuierliches Monitoring und eine Anomalieerkennung. So schütze ich die Integrität der Infrastruktur nicht nur gegen plumpe Brute-Force-Attacken, sondern behalte auch subtilere Abweichungen im Blick, die auf Manipulationen hindeuten könnten.

🔴 Kritische Meldungen weisen auf konkrete Angriffsversuche gegen Integrität oder Vertraulichkeit hin. Dazu gehören Path-Traversal-Angriffe mit dem Ziel, auf nicht vorgesehene Dateien zuzugreifen, versuchte Rechteausweitungen, um administrative Zugriffsrechte zu erlangen, Brute-Force-Angriffe durch massenhaftes Durchprobieren von Zugangsdaten, Credential Stuffing mit zuvor geleakten Anmeldedaten, Denial-of-Service-Angriffe (DoS) zur gezielten Überlastung von Diensten sowie aggressives Web Scraping, bei dem Inhalte automatisiert und in hoher Frequenz abgegriffen werden.

🟡 Warnmeldungen betreffen sicherheitsrelevante Prüf- und Manipulationsversuche. Dazu zählen manipulierte HTTP-Methoden, Cross-Site-Scripting (XSS) zur Code-Injektion, Verzeichnis-Scanning zur Pfaderkennung, automatisierte Schwachstellensuche, Footprinting zur Informationsgewinnung sowie Open-Redirect-Versuche zur missbräuchlichen Weiterleitung auf externe Ziele. Diese Aktivitäten bedeuten nicht zwangsläufig eine erfolgreiche Kompromittierung, weisen jedoch auf aktive Aufklärung oder Angriffsvorbereitung hin.

🟢 Formal erfolgreiche Zugriffe sind technisch unauffällig, können jedoch missbräuchlich sein. Datenabfluss innerhalb legitimer Sitzungen oder die Nutzung gültiger Zugangsdaten lassen sich nicht über Statuscodes identifizieren, sondern nur über Anomalieerkennung, wie ungewöhnliche Datenvolumina oder atypisches Nutzerverhalten.

| 🚦HTTP-Code | 📄Status | 🎯Angriffsvektoren | 🛡️Schutzmaßnahmen |

|---|---|---|---|

| 🔴 403 | Forbidden | Path Traversal, Privilege Escalation | Filterung, Monitoring |

| 🔴 401 | Unauthorized | Brute-Force, Credential Stuffing | Filterung, Monitoring |

| 🔴 429 | Too Many Requests | DoS, Aggressive Web Scraping | Monitoring, Filterung |

| 🟡 405 | Method Not Allowed | Manipulation, Cross-Site-Scripting | Filterung |

| 🟡 404 | Not Found | Directory Scanning, Vulnerability Probing | Filterung |

| 🟡 301 | Moved Permanently | Footprinting, Misconfiguration, Open Redirect | Monitoring |

Verfügbarkeit durch Monitoring mit Prometheus

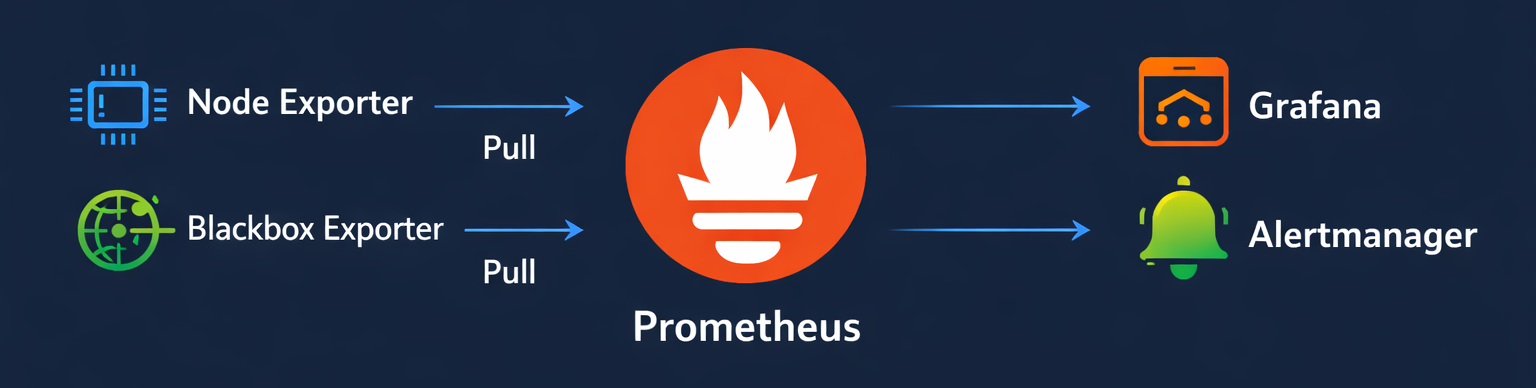

Verfügbarkeit bedeutet, dass meine Dienste bereitstehen, wenn sie gebraucht werden. Um das messbar zu machen, nutze ich Prometheus als zentrales Herzstück. Das System arbeitet nach dem Pull-Prinzip: Es steuert aktiv meine verschiedenen Hosts an und holt sich dort die Metriken ab. Ein großer Vorteil: Wenn ein Host nicht antwortet, erkennt Prometheus das sofort als kritischen Zustand. So unterscheide ich schnell, ob nur eine App spinnt oder die ganze Hardware weg ist. Die Datenlieferanten sind dabei die Node Exporter, die direkt auf den zu überwachenden Hosts laufen. Sie liefern die nötige Systemtiefe und melden Rohdaten wie CPU-Last, RAM-Verbrauch oder Festplatten-Status, wodurch ich Engpässe erkenne, bevor der Dienst quittiert.

Zusätzlich simuliert der Blackbox Exporter die Sicht eines externen Nutzers, indem er die Erreichbarkeit von außen über HTTP-Statuscodes und Antwortzeiten prüft. Während die Node Exporter also „unter die Haube“ der Server schauen, bewertet der Blackbox Exporter die tatsächliche Verfügbarkeit der Web-Dienste im Netz. Die Krönung des Setups bilden Alertmanager und Grafana: Der Alertmanager übernimmt die Logik hinter den Warnmeldungen, gruppiert und filtert Alarme, um mich bei echten Problemen gezielt zu benachrichtigen. Grafana visualisiert die gesammelten Daten in Dashboards. Das erlaubt mir Echtzeit-Kontrolle und die Analyse historischer Verläufe, um mein System langfristig stabil zu halten.

Im Zusammenspiel aller Komponenten entfaltet das Monitoring somit seine volle Stärke: Die Exporter liefern fleißig ihre Metriken, Prometheus sammelt alles zentral ein und behält den Überblick. Der Alertmanager schlägt Alarm, wenn es wirklich zählt und Grafana verwandelt nackte Zahlen in aussagekräftige Dashboards.

Die folgende Tabelle fasst noch mal alle Komponenten des Monitoring, sowie ihren Fokus und Bedeutung für die Verfügbarkeit zusammen. Sie zeigt auf einen Blick, wie jede Komponente dazu beiträgt, das Monitoring effizient, zuverlässig und reaktionsschnell funktioniert. Insgesamt ergibt sich daraus ein ganzheitliches System, das nicht nur Überwachung ermöglicht sondern auch schnelle Entscheidungen und proaktive Maßnahmen unterstützt.

| Komponente | Fokus & Aufgabe | Relevanz für Verfügbarkeit |

|---|---|---|

| 🧠 Prometheus | Zentrale Metrik-Datenbank | Datenbasis für Analyse |

| 🕵️ Node Exporter | Host- & Hardware-Status | Schutz vor Ressourcen-Limit |

| 🌐 Blackbox Exporter | Externer Erreichbarkeits-Check | Verifizierung der Uptime |

| 🚨 Alertmanager | Intelligente Alarmierung | Minimierung der Reaktionszeit |

| 📊 Grafana | Dashboard & Visualisierung | Schnelle Lagebeurteilung |